Introducción

Hemos llegado a la última lección de nuestro curso. Hemos diseñado el para quién (L1), el qué (L2), el cómo (L3), el dónde (L4) y el con qué (L5). Ahora, abordamos el componente final y, quizás, el más crítico de la docencia: el proceso de evaluar el desempeño y, lo que es más importante, comunicar esa evaluación al estudiante. Esta es la fase donde la alineación de nuestro curso se pone a prueba y donde tenemos la mayor oportunidad de fomentar un crecimiento real.

El dilema que enfrentamos ahora es la «caja negra» de la calificación. Para el estudiante de posgrado, nada es más frustrante que dedicar horas a un proyecto profesional y recibir de vuelta solo una calificación (Ej. «8») o un comentario vago («Buen trabajo, pero necesita más profundidad»). Esta práctica tradicional no respeta su autonomía (L1), no les ayuda a mejorar y rompe la confianza. La calificación se percibe como un acto de juicio subjetivo, no como parte del aprendizaje.

En esta lección final, desmantelaremos ese modelo. Introduciremos la evaluación auténtica como el estándar de oro para medir la competencia profesional. Y lo más importante, dominaremos la herramienta de transparencia más poderosa: la rúbrica. Finalmente, diferenciaremos la «calificación» (un acto de medición) de la «retroalimentación» (un acto de enseñanza), y aprenderemos a usar la tecnología de Classroom para hacer que esta última sea formativa, accionable y la parte más valiosa de nuestro curso.

Desarrollo del tema

El problema de la evaluación tradicional vs. la evaluación auténtica

La mayoría de nosotros fuimos educados bajo un modelo de evaluación tradicional. Este modelo se centra en preguntas que tienen una respuesta correcta predeterminada (opción múltiple, respuesta corta, definir un término). Su objetivo es verificar si el estudiante puede recordar o reconocer el contenido que el docente transmitió. Como vimos en la Lección 2, este enfoque solo mide los niveles más bajos de la Taxonomía de Bloom y es completamente inadecuado para un posgrado profesionalizante.

La evaluación auténtica, un término popularizado por Grant Wiggins (1998), invierte este paradigma. En lugar de preguntar por el contenido, la evaluación auténtica le pide al estudiante que use el contenido para realizar una tarea compleja. El objetivo no es medir lo que el estudiante sabe, sino lo que puede hacer con lo que sabe. Las características de una evaluación auténtica son:

- Es realista: el problema o la tarea refleja la complejidad, la ambigüedad y el contexto del mundo profesional real. (Ej. No «Defina el liderazgo», sino «Resuelva este conflicto de equipo»).

- Requiere juicio e innovación: no hay una «única respuesta correcta». El estudiante debe aplicar su juicio, analizar datos y crear una solución defendible.

- Es una tarea de desempeño: pide al estudiante que «haga» el trabajo de la disciplina (diagnosticar, diseñar, proponer, crear).

- Implica un reparto de habilidades: al igual que en el trabajo real, la tarea requiere que el estudiante integre múltiples habilidades (análisis, comunicación, colaboración, tecnología).

Como puede ver, los métodos que exploramos en la Lección 3 (Método de Caso, ABP) y las tareas interactivas que diseñamos en la Lección 5 (lienzos de Google Slides, informes en Docs) son evaluaciones auténticas. El problema que queda es: ¿cómo calificamos algo tan complejo de manera justa, consistente y eficiente?

Figura 1

La evaluación auténtica evalúa el aprendizaje a través de tareas que simulan situaciones y desafíos del mundo real, en lugar de preguntas teóricas

La rúbrica: la herramienta de la alineación y la transparencia

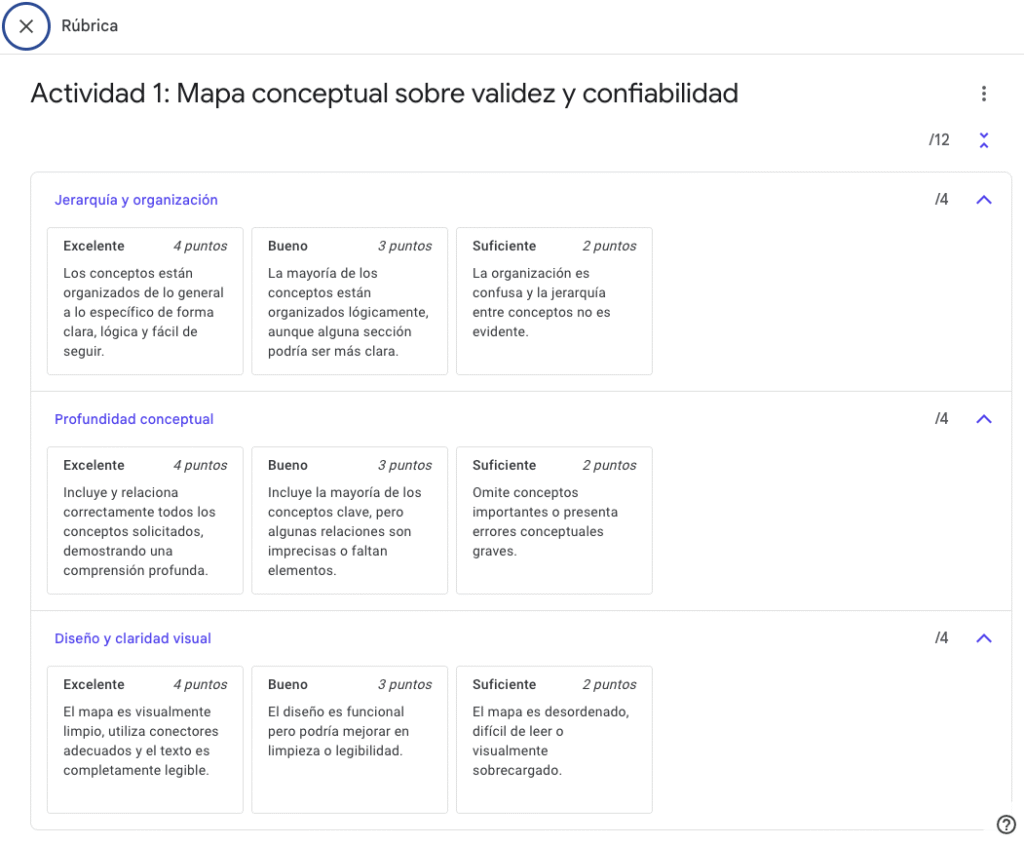

La respuesta es la rúbrica analítica. Una rúbrica es simplemente una herramienta de puntuación que articula las expectativas para una tarea. Descompone una tarea compleja en sus componentes (criterios) y describe cómo se ve la calidad en cada uno de esos componentes (niveles de desempeño).

Para nuestro estudiante de posgrado (L1), la rúbrica es esencial. Es el contrato que le dice exactamente cómo se medirá su éxito. Para nosotros como docentes, es la herramienta que garantiza que estamos aplicando nuestra Alineación Constructiva (L2). Los criterios de nuestra rúbrica no deben ser otros que los objetivos de aprendizaje que nos propusimos.

Existen dos tipos de rúbricas: holísticas y analíticas.

- Rúbrica holística: da una sola puntuación global («Este trabajo es un 4 de 5»). Es rápida pero inútil para la retroalimentación. No le dice al estudiante por qué es un 4.

- Rúbrica analítica: descompone la tarea en sus componentes (dimensiones/criterios) y califica cada uno por separado. Esta es la única que deberíamos usar en el posgrado.

La siguiente tabla desglosa los componentes de una rúbrica analítica efectiva, usando como ejemplo la tarea de «Análisis de Caso» que hemos venido trabajando.

Tabla 1

Componentes de una rúbrica analítica para un análisis de caso

| Componente | Descripción | Ejemplo de aplicación |

|---|---|---|

| 1. Criterios (Dimensiones) | Las filas. Son los «qué» estamos midiendo. Deben estar directamente alineados con los objetivos de aprendizaje de la tarea (L2). | Diagnóstico del Problema Central Calidad y Uso del Análisis de Datos Viabilidad de la Recomendación Propuesta Claridad y Profesionalismo de la Comunicación |

| 2. Escala de Desempeño | Las columnas. Los niveles de calidad. Es mejor usar descriptores (Ej. Excepcional, Competente) que números (Ej. 4, 3) para definir el nivel. | Nivel 4: Excepcional Nivel 3: Competente (Este debe ser el estándar esperado para aprobar) Nivel 2: En Desarrollo Nivel 1: Inadecuado |

| 3. Descriptores | El corazón de la rúbrica. Son las celdas que describen cómo se ve el desempeño en un criterio específico para un nivel específico. Deben ser descriptivos, no evaluativos. | Mal descriptor (evaluativo): «Diagnóstico muy bueno». Buen descriptor (descriptivo): «Identifica con precisión el problema central y los problemas secundarios subyacentes, diferenciando claramente los síntomas de las causas raíz». |

Nota. Adaptado de Stevens y Levi (2013), Introduction to Rubrics.

La buena noticia es que Google Classroom tiene una herramienta de Rúbricas integrada en la creación de «Tareas». Usted puede construir esta tabla (Criterios, Niveles, Descriptores) directamente en la plataforma. Cuando califica, simplemente hace clic en la celda del descriptor que mejor se ajusta al trabajo del estudiante (Ej. Criterio 1 = Nivel 4, Criterio 2 = Nivel 3). Classroom calcula automáticamente la calificación, la comparte con el estudiante (para que vea exactamente por qué obtuvo esa nota) y le ahorra horas de trabajo.

Figura 2

Las rúbricas en Google Classroom

De la calificación a la retroalimentación: el ciclo formativo

La rúbrica maneja la calificación (el juicio sumativo). Pero la calificación es la parte menos importante de la evaluación. La parte más importante es la retroalimentación (el acto formativo). La retroalimentación es la información que damos al estudiante para ayudarle a cerrar la brecha entre su desempeño actual y el desempeño deseado (Brookhart, 2017).

Como docentes de posgrado, nuestro objetivo no es «justificar la nota». Nuestro objetivo es «mejorar el desempeño futuro». Por lo tanto, nuestra retroalimentación debe cambiar drásticamente. La retroalimentación tradicional (el «lápiz rojo») es reactiva, se enfoca en el error y es desmoralizante. La retroalimentación formativa es proactiva, se enfoca en la mejora y es accionable.

Grant Wiggins (2012) ofrece diversas claves para una retroalimentación efectiva, que adaptamos aquí para nuestro contexto:

- Orientada a la Meta: debe estar ligada a la rúbrica. No «confuso». Sino: «Tu ‘Viabilidad de la Recomendación’ (Criterio 3) fue ‘En Desarrollo’ porque, como dice el descriptor, no incluiste un análisis de costos».

- Accionable: no solo señala el error, sino que da un camino para corregirlo. No «Cita mal». Sino: «Estás usando APA 6, pero este posgrado requiere APA 7. Aquí tienes la guía oficial para corregir el formato de tus citas web».

- Específica y Concreta: no «Buen trabajo». Sino: «La forma en que usaste la Tabla 3 para refutar el argumento del CEO fue un ejemplo ‘Excepcional’ de análisis de datos (Criterio 2)».

- Oportuna: no 6 semanas después del final del curso. La tecnología de Google nos permite ser increíblemente oportunos.

- Constante: el estudiante debe tener la oportunidad de usar la retroalimentación.

Aquí es donde todo nuestro curso se conecta. La tecnología de Google Suite permite un ciclo de retroalimentación poderoso que la docencia tradicional no podía.

Figura 3

El ciclo de retroalimentación formativa en Google Suite

Este ciclo es el pináculo de la docencia profesionalizante. Es alineado, transparente, respetuoso del adulto y utiliza la tecnología para fomentar la maestría, no solo para medir la deficiencia.

Actividad autónoma

Conclusión

En esta lección final, hemos cerrado el círculo del diseño docente. Vimos que la evaluación no es un apéndice del curso, sino la ejecución de su promesa. La evaluación auténtica mide las competencias que importan, no la memorización que se olvida.

La rúbrica analítica es nuestra herramienta para hacer esta evaluación justa, transparente y eficiente, y se integra perfectamente en Google Classroom. Más importante aún, hemos separado la calificación (medición) de la retroalimentación (enseñanza).

La retroalimentación efectiva, como la que se articula en el ciclo formativo de Google Suite, es la conversación más importante que tenemos con nuestros estudiantes. Es cómo les mostramos el camino de «en desarrollo» a «competente» y de «competente» a «excepcional». Al final del día, el diseño de nuestro curso solo es tan bueno como la calidad de las conversaciones de aprendizaje que genera.

Podcast de síntesis: la lección en audio

Como complemento, este recurso auditivo recapitula los conceptos fundamentales de la lección.

Bibliografía de referencia

- Brookhart, S. M. (2017). How to give effective feedback to your students. ASCD.

- Stevens, D. D., & Levi, A. J. (2013). Introduction to rubrics: An assessment tool to save grading time, convey effective feedback, and promote student learning. Stylus Publishing.

- Wiggins, G. (2012). 7 Keys to effective feedback. Educational Leadership, 70(1), 10-16.

- Wiggins, G. P. (1998). Educative assessment: Designing assessments to inform and improve student performance. Jossey-Bass.

- Biggs, J. B., & Tang, C. (2011). Teaching for quality learning at university: What the student does (4.ª ed.). McGraw-Hill/Open University Press.